TensorFlow是一种流行的机器学习框架,它可以用于各种应用程序,包括计算机视觉和自然语言处理。对于开发人员来说,将TensorFlow应用程序部署到iOS设备上可能是一个挑战。在本文中,我们将介绍如何将TensorFlow模型部署到iOS设备上,并将其上架到苹果应用商店。

首先,让我们来了解TensorFlow模型是如何工作的。TensorFlow模型由两部分组成:模型定义和模型参数。模型定义是模型的结构,它描述了模型的输入、输出和各个层之间的连接方式。模型参数是模型训练过程中学习到的权重和偏差,它们用于计算模型的输出。

在将TensorFlow模型部署到iOS设备上之前,我们需要将模型转换为Core ML格式。Core ML是苹果推出的机器学习框架,它可以将各种机器学习模型转换为iOS设备上可用的格式。TensorFlow提供了一个工具,可以将TensorFlow模型转换为Core ML格式。我们可以使用以下命令将TensorFlow模型转换为Core ML格式:

```

tensorflow.python.tools.optimize_for_inference --input=tf_model.pb --output=coreml_model.mlmodel --input_names=input --output_names=output --frozen_graph=True

```

其中,tf_model.pb是TensorFlow模型文件的路径,coreml_model.mlmodel是转换后的Core ML模型文件的路径,input和output是模型的输入和输出名称。

接下来,我们需要将Core ML模型集成到我们的iOS应用程序中。我们可以使用Xcode开发工具来创建一个新的iOS应用程序,并将Core ML模型添加到项目中。我们可以使用以下代码来加载Core ML模型:

```

guard let model = try? VNCoreMLModel(for: MyCoreMLModel().model) else {

fatalError("Failed to load Core ML model")

}

```

其中,MyCoreMLModel()是我们在Xcode中创建的Core ML模型的名称。我们可以使用VNCoreMLRequest类来执行模型推理,并将输入图像传递给模型:

```

let request = VNCoreMLRequest(model: model) { (request, error) in

// Handle the output of the model

}

let handler = VNImageRequestHandler(cvPixelBuffer: pixelBuffer)

try? handler.perform([request])

```

其中,pixelBuffer是输入图像的像素缓冲区。我们可以在模型输出的回调函数中处理模型的输出。

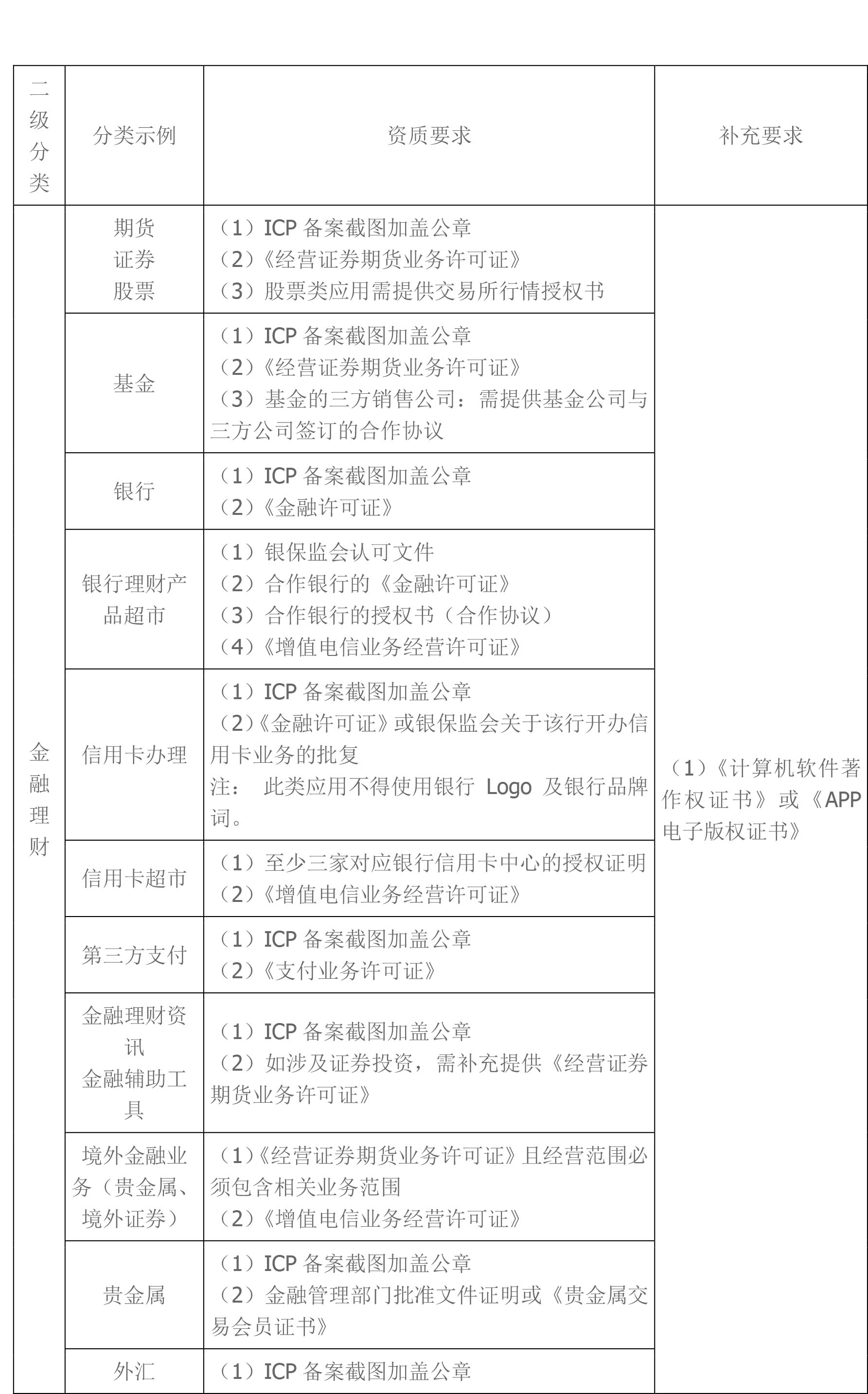

最后,我们需要将我们的iOS应用程序上架到苹果应用商店。在提交应用程序之前,我们需要确保我们的应用程序遵循苹果的App Store审核指南。其中,与机器学习相关的指南包括:

- 应用程序必须使用Core ML框架来执行机器学习任务。

- 应用程序必须遵循苹果的隐私政策,并获得用户的明确许可。

- 应用程序必须提供用户友好的界面,以便用户理解应用程序如何使用他们的数据。

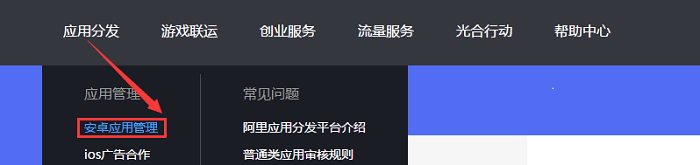

在提交应用程序时,我们需要提供应用程序的元数据,包括应用程序的名称、描述、图标和截图。我们还需要提供应用程序的版本号和构建号,以便我们可以在将来更新应用程序。

在提交应用程序之后,我们需要等待苹果审核应用程序。审核过程通常需要几天时间,但可能需要更长时间,具体取决于应用程序的复杂性和审核队列的长度。

总结来说,将TensorFlow模型部署到iOS设备上并将其上架到苹果应用商店可能是一个挑战,但是通过遵循苹果的审核指南和使用Core ML框架,我们可以开发出高质量的应用程序,并将它们提供给数百万用户。